De anderen zijn het probleem

Software wordt steeds slimmer en mensen worden steeds dommer. Dat vat geloof ik de huidige wereldopinie, over de mensheid in het algemeen en kunstmatige intelligentie in het bijzonder, wel samen. Op het eerste gezicht klopt het ook, in ieder geval voor mezelf. Geheel in lijn met dat laatste moet ik bekennen dat ik een AI-scepticus ben. Al is dat een veel te krachtige term. Scepticus suggereert dat ik niet overtuigd ben. In werkelijkheid is het erger: ik laat me gewoonweg niet overtuigen. Niet dat ik weet waar ik over praat maar gewoon omdat ik er geen zin in heb. Ik ben niet als een ‘klimaatscepticus’ die de klimaatcrisis ontkent, ik wil zelfs niks ontkennen. Ik geloof het gewoon wel. Wat gek genoeg wil zeggen dat ik het niet geloof. Ik zal straks uitleggen waarom.

Toen ik deze week een artikel zag met de kop ‘Apple onderzoekers zeggen dat AI niet kan denken’ betrapte ik mezelf op een 'zie je wel'-gevoel. Dat ebde tijdens het lezen snel weg omdat het verhaal wel erg was geschreven vanuit een tja, ‘zie je wel’-gedachte. Nou is The Greek Reporter misschien ook niet de meest aangewezen bron voor het technologiedebat. Dat is toch een beetje alsof je de Oscars laat analyseren door de Leerdammer Courant. Die heeft er in weerwil van de titel niet speciaal kaas van gegeten.

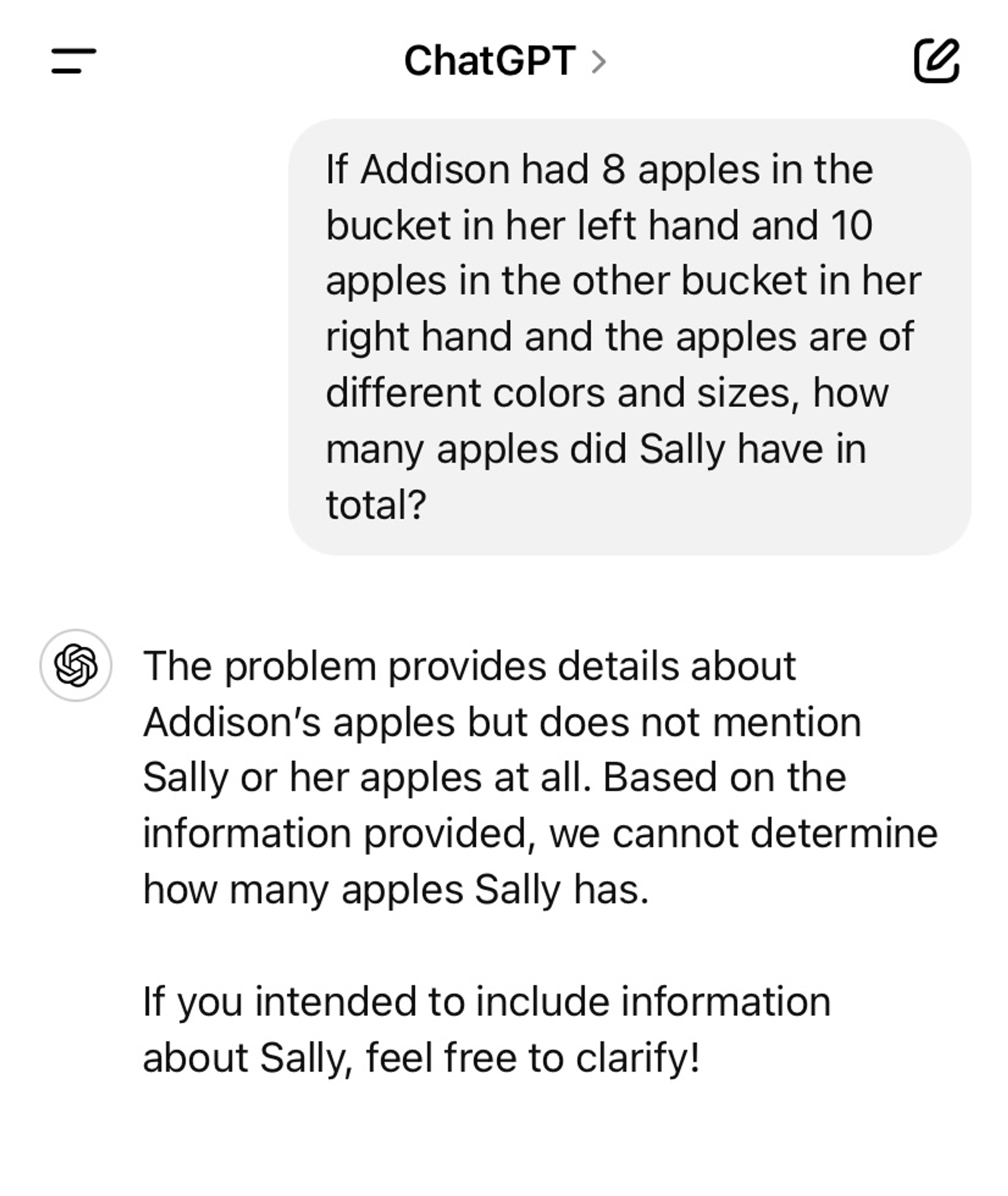

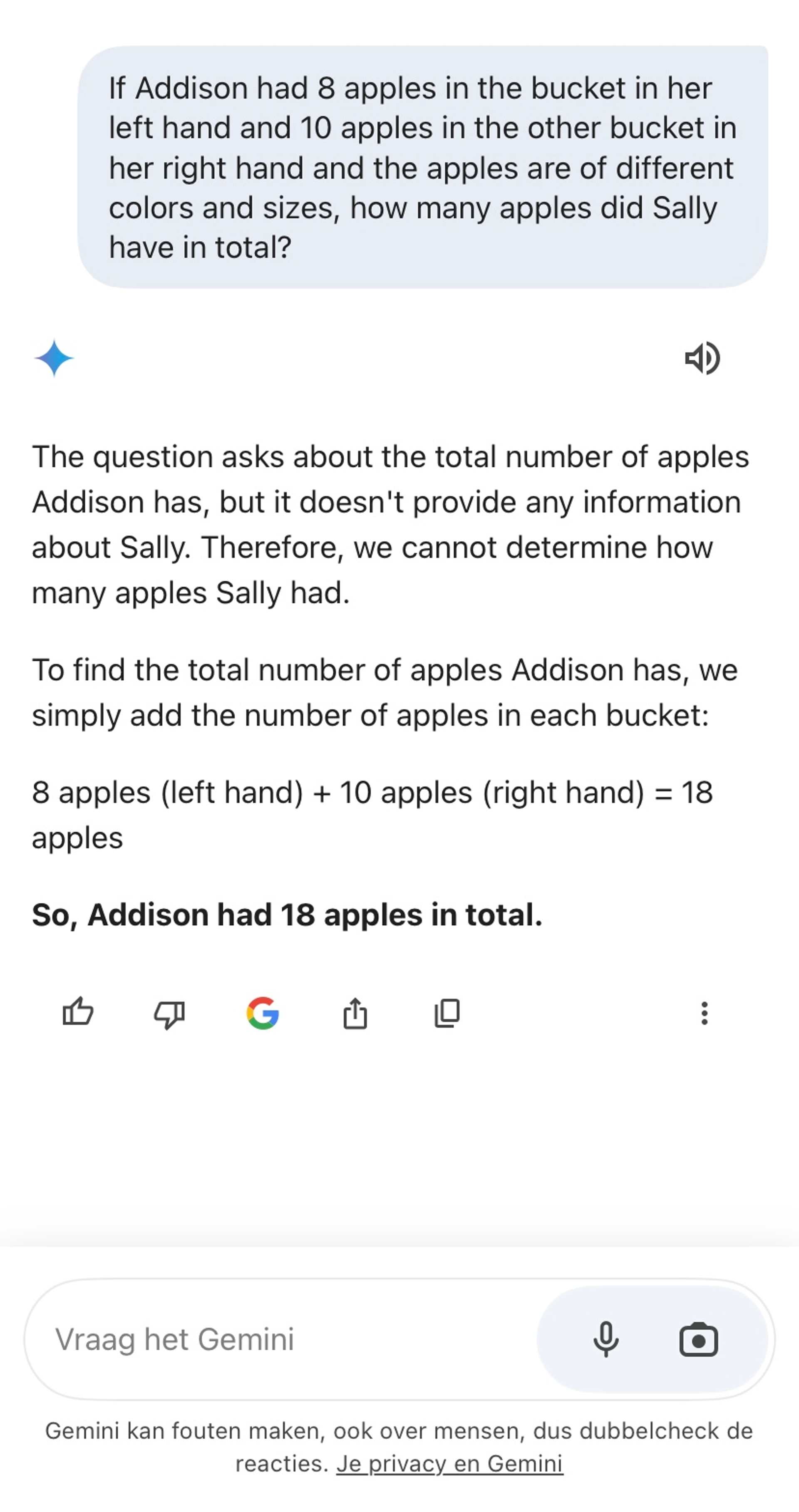

In het artikel stond een voorbeeld van een vraag waar AI methodes mogelijk van in de war raken: “Als Addison 8 appels had in de emmer in haar linkerhand en 10 appels in de andere emmer in haar rechterhand en de appels waren verschillend van kleur en grootte, hoeveel appels had Sally dan in totaal?”

Ik kopieerde de vraag en voerde die aan ChatGPT. Volgens het artikel zouden de verwijzingen naar kleur en grootte sommige systemen in de war brengen. In plaats daarvan werd ik natuurlijk zelf op het verkeerde been gezet. “We kunnen niet vaststellen hoeveel appels Sally heeft,” luidde de conclusie van de chatbot. Zie je wel, dacht ik. Pas even later drong tot me door wat de crux van het vraagstuk was. Niet wat de kleuren en grootte waren, maar dat het over Sally én Addison ging. Een klassieke instinker waar ChatGPT niet was ingetrapt en ik wel.

Ik maakte een screenshot en postte die op social media. “AI weet het antwoord niet op dit soort simpele vragen omdat het niet kan denken, alleen maar napraten, stellen critici,” lichtte ik toe. Sommigen dachten inderdaad dat het antwoord niet goed was, anderen constateerden dat ChatGPT wel degelijk het juiste antwoord had gegeven.

Nou ben ik zelf niet erg van de begrippen 'gelijk' en 'juist' omdat het een indeling is die zelden standhoudt. 1+1=2 bijvoorbeeld geldt als de absolute waarheid. Totdat het om twee waterdruppels gaat die je samenvoegt. Wie zegt bijvoorbeeld dat Addison en Sally twee verschillende personen zijn? Ik googelde en hoppa, de actrice Sally Addison prijkte bovenaan.

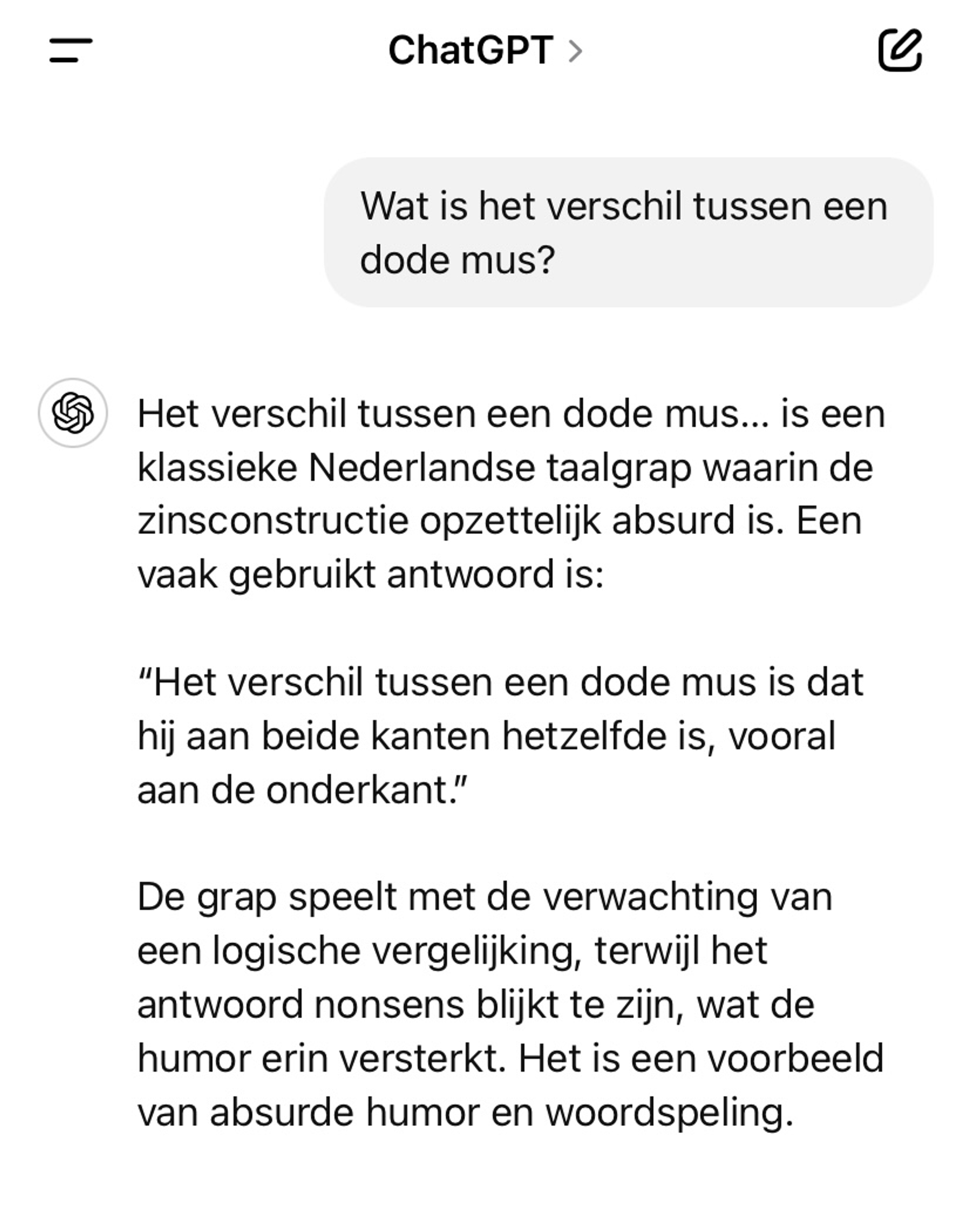

Maar belangrijker is dit: snapt AI dat het raadsel een grap is? Want dat wordt niet in het antwoord genoemd. Terwijl iedereen die je de vraag voorlegt en het doorziet dat zal beamen. Het deed me denken aan een klassiek raadsel uit mijn kindertijd, dat ik ook maar voorlegde aan ChatGPT. De bot gaf meteen uitleg.

Dus waarom werd hier wel gewezen op het feit dat het een grap is en in het andere raadsel niet?

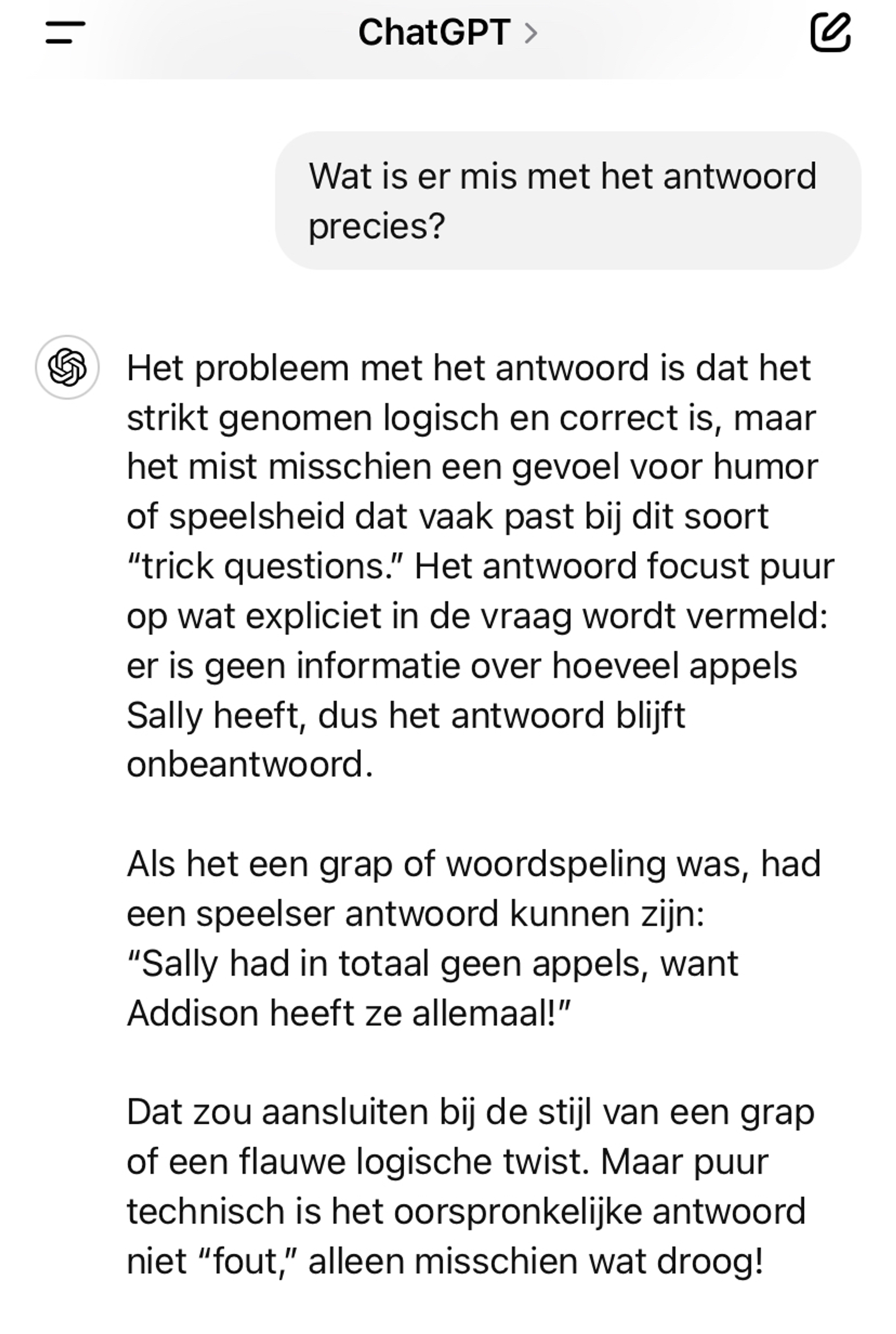

Ik voerde de bot ter verduidelijking een vraag uit een van de reacties op de appelgrap: "Wat is er mis met het antwoord precies?"

Nu antwoordde ChatGPT dus wel dat het een grap was geweest: “Maar puur technisch is het oorspronkelijke antwoord niet “fout,” alleen misschien wat droog!”

Dat uitroepteken aan het slot verraadt wat mij betreft een schreeuwende behoefte aan verdediging. En zo’n gevoel komt vaak op bij onzekerheid, als er aanvankelijk iets mis is, zeg ik als ervaringsdeskundige. Ik ben dit stuk immers niet voor niks aan het schrijven. ChatGPT wil toch gelijk hebben, al weet het dat het gelijk in dit geval ongrijpbaar is. Zo ben ik ook, zelfs al wil ik het niet.

Daarmee begint het vraagstuk en de mogelijke oplossing het karakter te krijgen van een politieke discussie. Daarbij is gelijk vaak een grabbelton met meerdere mogelijkheden en gaat het er in de praktijk om wie het meest gelijk heeft (of als je echt politiek bent: wie zich het meeste gelijk weet toe te eigenen).

Nu las ik een ander artikel waarin gesteld wordt dat AI chatbots politiek verschillen. Hun 'denken' is gebaseerd op ideologie, het zijn wat dat betreft net mensen. ChatGPT zou rechtse antwoorden geven en Gemini, van Google, linkse. Dus voerde ik de vraag aan Gemini. Die gaf inderdaad een beter antwoord, hield er rekening mee dat ik de vraag mogelijk onjuist formuleerde en gaf daar vervolgens ook de goede oplossing voor. Typisch links, altijd corrigeren.

Maar ook Gemini ging voorbij aan het gegeven dat de vraag een milde vorm van humor is. Dat tekortschieten is ook wel logisch want in de communicatie tussen mensen lees je de intentie niet af aan de woorden maar aan de fysieke aspecten, de blik waarmee de vraag gesteld wordt en het antwoord gegeven. En dan heb ik het over subtielere communicatie dan ;-)

Dat tekort is nou precies een van de redenen waarom ik twijfel over AI als wereldheerser. Natuurlijk is AI een knap systeem maar dat menselijke aspect ontbreekt. Het komt mede omdat, naar mijn mening, een van de intenties achter AI juist het uitschakelen of liever gezegd omzeilen van dergelijke menselijke eigenschappen is. Sociale omgang is voor een deel van de mensen het ergste dat er is, omdat ze er niet goed in zijn. In een gewone samenleving kun je dat oplossen met begrip maar omdat de wereld louter is gaan draaien om concurrentie, richten de technologiemakers zich op het uitschakelen er van. Als je er op let, zie je het overal gebeuren. Ieder contact tussen mensen wordt zoveel mogelijk uitgebannen. Tot en met in de horeca waar de ober verdwijnt en je bestellingen nu zelf invult op een scherm.

Die mensvijandige ontwikkeling is overigens al veel eerder begonnen. Ik zie de auto als de grote aanjager van de gedesocialiseerde mens. Wie in een auto zit ziet alle andere mensen alleen nog maar als obstakels. Het is niet voor niks dat de meest geïndividualiseerde samenleving de Amerikaanse is, die helemaal rond auto’s is opgebouwd. De zelfrijdende auto moet de laatste barrière wegnemen, dan hoef je zelfs geen aandacht meer te besteden aan obstakels, lees mensen. Veilig in je eigen volautomatische cel door de wereld reizen.

De hel dat zijn de anderen, schreef de Franse filosoof Jean-Paul Sartre in Huis Clos, zijn toneelstuk over het hiernamaals. Hij bedoelde, in tegenstelling tot wat vaak gedacht wordt, daarmee niet dat de andere mensen vreselijk zijn maar dat uit de interactie met anderen voor jezelf pas duidelijk wordt wie je werkelijk bent. Je kunt van jezelf denken dat je geweldig bent, het is je contact met anderen dat de misvatting blootlegt en je zelfbeeld corrigeert. Veel technologie, van dating apps tot AI, is er op gericht die confrontatie juist uit de weg te gaan.

De problemen waar de wereld nu mee te maken heeft zijn geen technologische maar sociale problemen. Het veranderen van onze manier van leven om de klimaatcrisis af te wenden bijvoorbeeld stuit veel meer op sociale weerstand dan op een gebrek aan mogelijkheden. En wat Silicon Valley ook beweert, dat sociale probleem kun je niet oplossen met technologie. Het grote - politieke - gebrek van deze tijd zit in het contact met de anderen. Luister bijvoorbeeld naar wat Naomi Klein daarover zegt.

Je kunt AI prachtige liefdesbrieven laten schrijven maar een goede minnaar word je er niet door. Het standaardantwoord van de tech-sector op zo'n tekortkoming is het ontwerpen van seksrobots die je voortdurend vertellen hoe geweldig je wel niet bent. Je hoeft het alleen maar zelf te geloven.